El

coste medio de una vulneración de datos es de 4,45 millones de dólares,

lo que supone un crecimiento del 15% en los últimos 3 años, de acuerdo

con la última edición del Cost of Data Breach Report

de IBM. En concreto, si hablamos de vulneraciones de datos en el sector

sanitario, el coste medio es de 11 millones de dólares, y en el caso de

las infraestructuras críticas, de más de 5 millones.

A esto se suma que la capacidad de actuación de los cibercriminales ha avanzado sustancialmente —el IBM Security X-Force Threat Intelligence Index

de 2023 señaló que los atacantes han pasado de necesitar una media de

dos meses para completar un ataque de ransomware a cuatro días— y que,

según el estudio del Global Security Operations Center

de Morning Consult de 2023, casi el 50% de los miembros de los equipos

de los Centros de Operaciones de Seguridad (SOC) asegura que el tiempo

medio que emplean en detectar y responder a un incidente de seguridad ha

aumentado en los últimos 2 años.

Estos son algunos de los datos que sirvieron para poner en contexto la mesa redonda La inteligencia artificial como activo en la ciberseguridad, que se celebró ayer en Madrid Tech Show y en la que participaron David Corral, IT/OT Head of Cybersecurity Architecture de Repsol; Xabier Mitxelena, General Director de BeDisruptive; e Isabel Tristán, Principal Security Sales de IBM para España, Portugal, Grecia e Israel.

En línea con los datos expuestos, Isabel Tristán situó el escenario para el debate señalando que “hay estudios que aseguran que la principal amenaza que detectan los CEO de las empresas para el crecimiento de sus compañías es la ciberseguridad. Es decir, que es una parcela crítica para la estrategia de cualquier compañía”.

La máxima responsable de Software de

ciberseguridad de IBM tradujo dichas preocupaciones en datos concretos:

“Los cibercriminales han evolucionado y son capaces de desplegar ataques

de ransomware en menos de tres días, mientras que el tiempo medio de

las empresas para detectar un incidente es de 7 meses y de 2 meses para

ser capaces de reaccionar ante uno de esos incidentes”.

La cuestión clave es, pues, ¿qué puede hacer

la IA en el ámbito de la ciberseguridad? Una respuesta que, como

señalaron todos los ponentes, necesita de una aclaración previa: como en

todos los ámbitos de la digitalización, la IA lleva usándose mucho

tiempo en el campo de la ciberseguridad; es ahora, con el boom de la IA

Generativa, cuando se habla de nuevas capacidades.

En palabras de David Corral: “La IA

Generativa trae consigo una serie de riesgos desde el punto de vista de

ciberseguridad, que estamos analizando y abordando; pero, sin duda, nos

trae también oportunidades en los ámbitos de precisión en detección de

amenazas, disminución de alertas para los equipos de respuesta,

automatización de procesos o enriquecimiento de la información para la

toma de decisiones, que también estamos explorando”.

No en vano, los profesionales de los SOC afirman que dedican aproximadamente un tercio de su jornada a investigar y validar incidentes que resultan no ser amenazas reales y el uso de la IA y la automatización permitiría —de hecho, como se expuso en la mesa redonda, ya lo está permitiendo— recortar el tiempo de detección y respuesta.

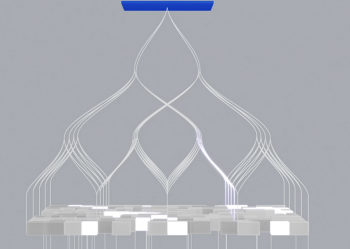

Elevar al analista

En este sentido, Isabel Tristán explicó cómo

se trabaja para facilitar esas oportunidades. “La visión de IBM es

elevar al analista de ciberseguridad, facilitando su trabajo y con las

distintas soluciones de ciberseguridad de la empresa”, algo que se

traduce en que “la IA embebida en las soluciones de ciberseguridad de

IBM como QRadar permite realizar investigaciones automáticas para ser

consumidas por el analista y reducir el tiempo de investigación medio de

2 días a menos de 30 minutos”.

Por su parte, Xabier Mitxlena explicó que

desde BeDisruptive pueden dar “pistas de soluciones que están dando

soporte al mercado en el uso de la IA Generativa, pero es importante

recordar que la IA es solo una herramienta, que puede ser utilizada

tanto a la hora de crear amenazas como para trabajar en su mitigación, y

que la intervención humana seguirá siendo esencial en este campo. Sobre

todo —explicó— el caballo de batalla es la falta de talento; de alguna

manera, se está afrontando la falta de manos y de cerebros humanos con

la IA Generativa”.

“En BeDisruptive tenemos una plataforma que

se basa en IA; protege al usuario, al dato… todo Zero Trust, y su mérito

diferencial es que se basa en IA”, incidió Mitxelena, quien puso

especial énfasis en la necesidad de “impulsar la capacitación y la

educación para aportar un enfoque disruptivo e innovador, que busca

generar valor para las empresas a través de la automatización y

simplificación de los modelos de gestión”.

Otro de los aspectos que se puso encima de

la mesa en relación directa con la capacitación es el de la práctica

habitual del buen gobierno, algo que aplica al campo de la IA al igual

que a cualquier tecnología disruptiva. En este sentido, David Corral

remarcó “el concepto de IA Responsable”, un elemento “clave para generar

entornos empresariales donde estos sistemas puedan amplificar la

productividad en nuestros procesos de negocio, potenciar su crecimiento y

a su vez presentar la debida robustez y diligencia, en consonancia con

una serie de principios y regulaciones a los que nos adherimos con

fuerte convicción”.

Un tema que de nuevo concitó el consenso de todos los ponentes de la mesa, el de la visión cross de dichos principios y regulaciones: no sólo asociados al uso de la inteligencia artificial en la ciberseguridad, sino a todos los componentes y principios que forman parte de esa IA responsable.